wget 递归下载整个网站(网站扒皮必备)

2016-02-28

有时间看到别人网站的页面比较漂亮,就想给扒皮下来,学习学习。分享一个我常用网站扒皮命令wget

这个命令可以以递归的方式下载整站,并可以将下载的页面中的链接转换为本地链接。

wget加上参数之后,即可成为相当强大的下载工具。

wget -r -p -np -k http://xxx.com/xxx

-r, --recursive(递归) specify recursive download.(指定递归下载)

-k, --convert-links(转换链接) make links in downloaded HTML point to local files.(将下载的HTML页面中的链接转换为相对链接即本地链接)

-p, --page-requisites(页面必需元素) get all images, etc. needed to display HTML page.(下载所有的图片等页面显示所需的内容)

-np, --no-parent(不追溯至父级) don't ascend to the parent directory.

另外断点续传用-nc参数 日志 用-o参数

拿我自己的网站扒皮试一下吧

wget -r -p -np -k https://wujunze.com/

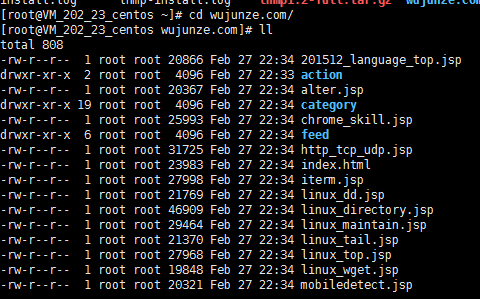

等网站递归下载完毕,你会发现你当前目录会有一个 wujunze.com的目录

进入这个目录看一下

熟练掌握wget命令,可以帮助你扒皮网站。

以上转载自:https://wujunze.com/linux_wget.jsp

小紫注

当然咯,这个命令只能扒静态资源,你就别指望把源码扒下来了,除非对方服务器配置有问题不解析服务端动态语言你所看到截图中的.jsp文件其实只是类似于伪静态的方式实现的,实际上都是JSP执行后输出的html而已

刚测试了下,这个命令除了字体下载不到,其他的完全没问题,非常给力。

这个可以用来抢救一些有珍贵静态资料的网站比如FL吧导航

我去下国外菊苣的博客群http://komkon.net/下的了,可是我下国内的网站CSS丢了、、、

这tm就有点尴尬了 他是怎么递归的

HTTrack表示笑了

我比较想知道他是如何递归的。。。

因为网站一般并不提供filelist。。。。。

如果说从sitemap上看的话,命令中并没有相关语句啊= =

P.S.不觉得多说评论框真的好丑好不搭么。。。

从html中读取载入的资源?

类似于蜘蛛么?那完全不能从任何页面中找到的页面是不是没法扒。。。

是没法扒,但页面肯定有。不然爬来也没用。

我也不知道,就是感觉好厉害,就先转了再说

评论框啊,我觉得都是淡灰色还挺搭网页背景色的。。。